La nostra prima volta al We Make Future

THE Ò-BLOG

“Chi conosce PyTorch?”

9 Giugno 2025

Tempo di lettura: 3 minuti

Chi conosce PyTorch? Due mani alzate. 😅

È iniziato così l’intervento del nostro CTO, Luca Antiga, sul palco del WMF – We Make Future. Un incipit che ci ha subito ricordato che non eravamo a “casa nostra”: non davanti a una platea di developer o super tecnici come noi, ma in mezzo a esperti di marketing, creativi, attivisti digitali, innovatori di ogni forma e settore.

Un evento “strano” per noi, ma anche una boccata d’aria fresca.

Abbiamo ascoltato, incontrato persone, trovato idee. E ci siamo messi alla prova condividendo il nostro modo di fare AI nell’industria.

Dentro il nostro modo di fare AI

A noi, più che parlare di AI, piace farla.

E farla insieme a chi ha voglia di cambiare le cose e generare valore.

Ma raccontarla bene è parte del nostro lavoro. Anzi, è il primo passo per darle forma. Saper comunicare le sue potenzialità anche fuori dai contesti più tecnici, aiuta a superare le barriere culturali che ancora rallentano la diffusione dell’intelligenza artificiale nei contesti produttivi. E questo vale soprattutto quando l’AI entra nelle fabbriche, negli impianti, nei luoghi dove ogni secondo conta, ogni errore si paga, e ogni innovazione deve dimostrare subito il suo valore.

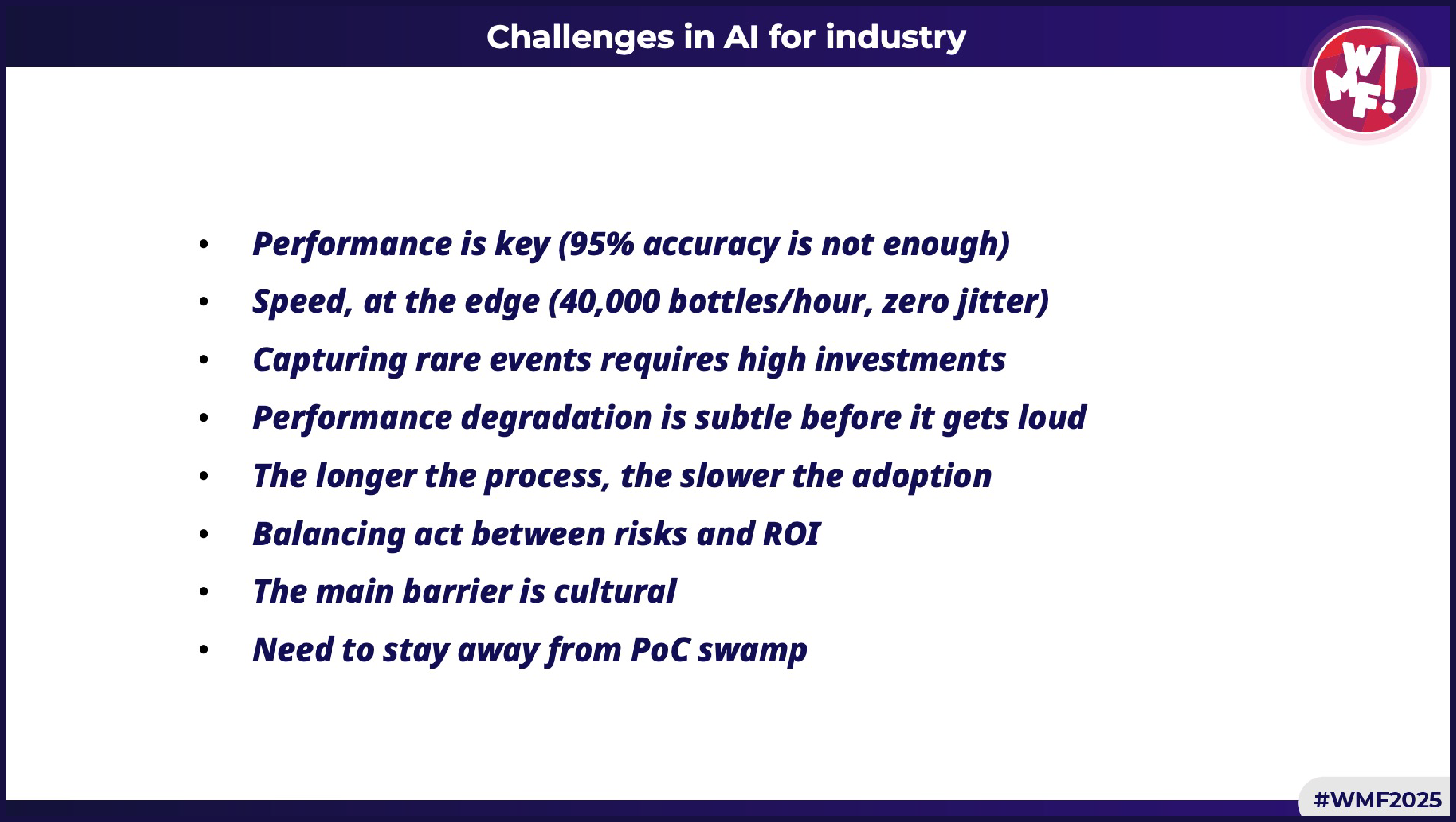

Le 8 sfide dell’AI applicata all’industria

Luca è partito da qui: dalle sfide dell’AI nel mondo industriale. Quelle che ogni giorno affrontiamo nei progetti insieme ai nostri clienti.

-

- Performance is the key – il 95% di accuratezza, nel contesto industriale, non basta: serve robustezza, spiegabilità, stabilità nel tempo.

- Velocità – l’AI deve stare al passo del processo: 40.000 bottiglie/ora, zero jitter.

- Eventi rari – rilevarli richiede grandi investimenti in dati e annotazioni, ma sono proprio quelli che il modello deve saper riconoscere.

- Degrado delle performance – i modelli si degradano prima in modo impercettibile, poi crollano all’improvviso: serve monitorarli e cogliere i segnali deboli.

- Processi lunghi = adozione lenta – più complesso è il processo, più serve pazienza (e fiducia) per adottare l’AI e generare valore per il business.

- Equilibrio rischi/ROI – ogni progetto è un compromesso tra investimento, impatto atteso e rischio percepito.

- Barriera culturale – la tecnologia non basta se le persone e i processi non sono pronti.

- Il pantano dei PoC – attenzione ai PoC che non diventano mai soluzioni operative!

In 5 anni, 3 cambi di paradigma

Per chi lavora da anni nel campo dell’AI, è evidente che non siamo più nella stessa fase di cinque anni fa. Luca ha ripercorso le tappe di questa evoluzione, come l’abbiamo vissuta (e costruita) anche in Orobix.

- Fase 1 – 2018: Train from scratch

Il deep learning inizia a entrare concretamente nei processi industriali. All’epoca, facevamo già da alcuni anni progetti di visione artificiale in produzione. Servivano tanti dati, annotati da personale esperto. Modelli piccoli, allenati da zero su ogni singolo problema. Risultati validi, ma davvero tanto sforzo.

- Fase 2 – 2022: Pretrained + fine-tuning

Con l’avvento dei vision transformer, arrivano i modelli pre-addestrati: basta fare fine-tuning con 20-30 immagini (ok, non sempre funziona proprio così, ma il salto è stato netto!). Serve meno supervisione umana, meno tempo, ma più risorse computazionali. È su queste basi che nasce AI-go, la nostra piattaforma per il training, test e deployment di sistemi di AI per l’ispezione visiva nel mondo manifatturiero. Industrial AI, made real… come ci piace dire!

- Fase 3 – 2025 (in corso): Promptable Multimodal Autonomous Agents

Con l’arrivo di GPT, siamo entrati nell’era degli agenti multimodali. Modelli che combinano immagini e linguaggio, e che possono rispondere a domande anche senza essere addestrati sui famosi dati rari. Posso mostrare al modello un esempio di pezzo buono, descrivergli alcune tipologie di difetti, e chiedergli di rilevarle. Non servono più lunghe campagne di raccolta dati. I tempi di delivery passano da mesi a giorni. Un cambio di paradigma enorme.

Ma come funziona davvero l’AI multimodale?

L’AI multimodale combina testo e immagini all’interno di un unico modello, capace di comprenderli insieme. Per farlo, le immagini vengono suddivise in piccole porzioni (patch) e trasformate in token d’immagine, simili a parole, tramite modelli come i Vision Transformer. Questi token vengono poi elaborati insieme a quelli testuali da un modello che apprende le relazioni tra ciò che “vede” e ciò che “legge”. In pratica, posso mostrare al sistema un esempio di pezzo buono, fargli vedere un pezzo da ispezionare e chiedergli: “Rileva eventuali anomalie come crepe, difetti estetici, deformità, macchie… e se trovi qualcosa, restituiscimi l’immagine con un bounding box sull’anomalia.”

Non serve addestrare ogni volta un nuovo modello: grazie al prompt engineering, posso guidare il modello con le istruzioni giuste. Il sistema risponde integrando contenuti visivi e testuali, restituendo testo, immagini o entrambi.

Questa è la base dei Vision Language Models (VLM), come Qwen 2.5 VL, Llama 4, Gemma 3, Gemini 2.5, GPT-4o e Claude 4, per citarne alcuni. Il risultato? Tempi di sviluppo ridotti, meno dati richiesti e applicazioni più flessibili – anche in ambito industriale (con le dovute accortezze, ma non possiamo svelare proprio tutti i nostri segreti!).

E quindi, cosa ci siamo portati a casa?

Al WMF siamo usciti dalla nostra comfort zone.

Abbiamo raccontato l’AI industriale a un pubblico più ampio.

Abbiamo ricevuto feedback, stimoli, domande interessanti.

Ma soprattutto abbiamo confermato una cosa: c’è bisogno di raccontare meglio l’AI, per far capire quanto valore può davvero generare.

Nel frattempo, noi continuiamo a farla. Se vuoi saperne di più, scrivici a 📩 info@orobix.com